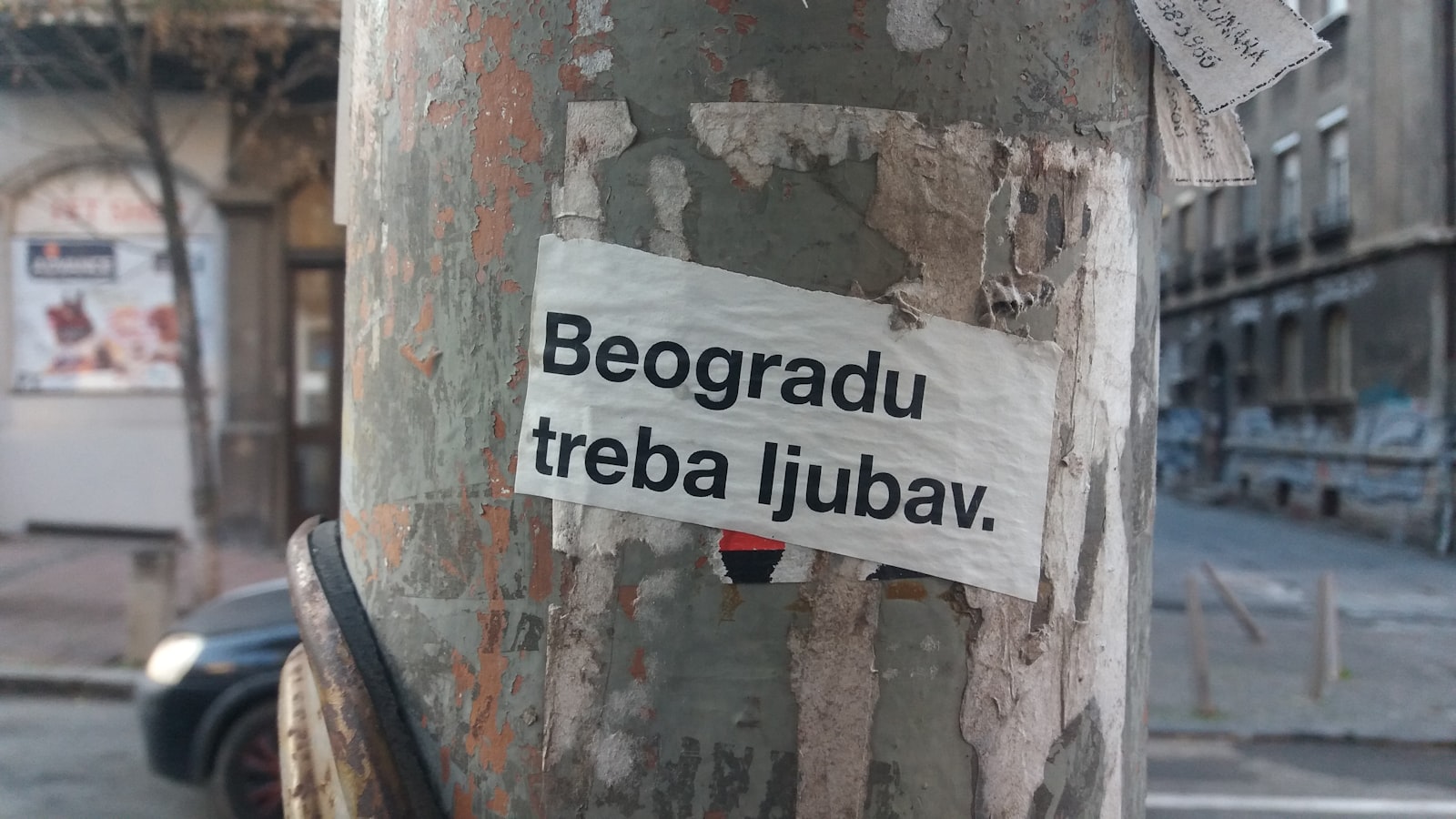

Foto de Marija Zaric en Unsplash

Una anécdota que revela el lado lúdico de los modelos generativos

En los últimos años, los grandes modelos de lenguaje (LLM, por sus siglas en inglés) se han convertido en herramientas esenciales para traducir, redactar y crear contenido. Sin embargo, más allá de los usos profesionales, también muestran un lado sorprendentemente humano cuando se enfrentan a preguntas inusuales. El caso reciente de Kagi Translate es un buen ejemplo: su sistema de inteligencia artificial respondió con humor y soltura a una pregunta que, en principio, no tenía nada que ver con traducción.

El experimento, compartido originalmente por usuarios que jugaban con el modelo, consistía en preguntarle al traductor qué diría Margaret Thatcher en un contexto extravagante. Aunque la premisa era absurda, la IA ofreció una respuesta coherente y con cierto tono irónico, lo que desencadenó una oleada de comentarios sobre el límite entre la creatividad y la responsabilidad en la generación automática de texto.

Entre la creatividad y la ética de los modelos de lenguaje

Este episodio pone de nuevo sobre la mesa el debate sobre cómo y por qué los modelos generativos pueden llegar a producir respuestas inesperadas. Su diseño, basado en el aprendizaje a partir de grandes volúmenes de texto, les permite combinar información y estilo de maneras que resultan a menudo imprevisibles incluso para sus desarrolladores. Esa flexibilidad creativa es, a la vez, su mayor fortaleza y su mayor desafío.

En el entorno de la traducción automática, donde la precisión y la neutralidad son clave, respuestas de este tipo sirven para evaluar hasta qué punto los sistemas han aprendido matices culturales, humorísticos o emocionales. En el caso de Kagi Translate, más que un fallo, el incidente se percibe como una muestra de que los modelos actuales pueden realizar interpretaciones contextuales mucho más ricas de lo que se suponía hace unos años.

Hacia una inteligencia artificial más consciente de su tono

Las empresas tecnológicas están afinando el control sobre el estilo, el tono y la intención comunicativa de sus modelos. El objetivo no es eliminar la creatividad, sino canalizarla de forma responsable, evitando interpretaciones inapropiadas sin restar frescura al resultado. La clave está en entrenar sistemas que comprendan el contexto social y emocional de cada interacción, no solo el contenido lingüístico.

Este tipo de anécdotas nos recuerda que la relación entre humanos y modelos de inteligencia artificial sigue siendo un territorio en construcción. La frontera entre lo divertido, lo técnico y lo ético continúa cambiando, y comprender cómo se comportan los modelos en escenarios inesperados es parte esencial de su evolución. En Trixología seguiremos atentos a estos fenómenos que, más allá de la curiosidad, marcan el rumbo del desarrollo responsable de la IA.