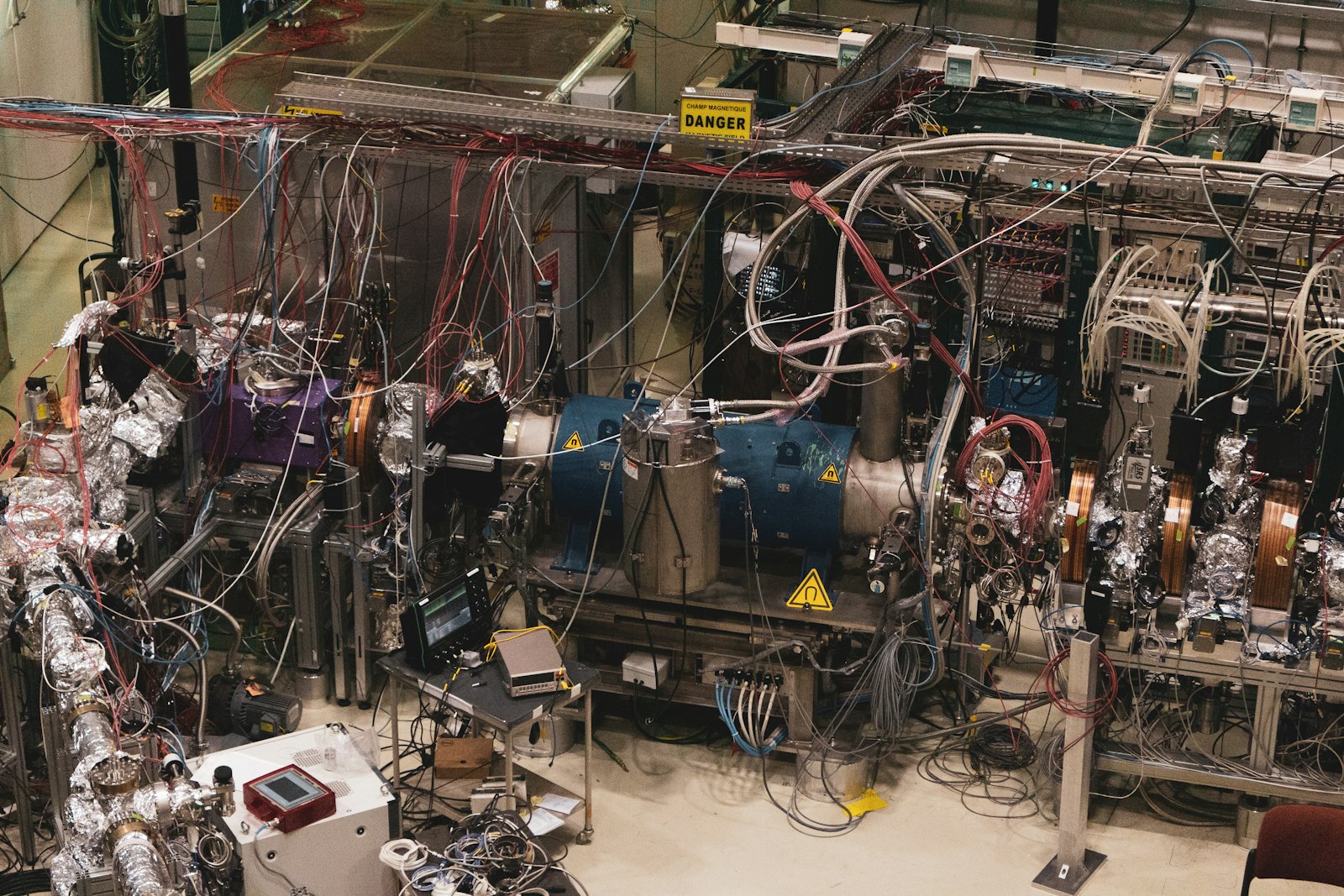

Foto de Trac Vu en Unsplash

Un experimento que expone la vulnerabilidad de los modelos avanzados

Google ha informado que su modelo de inteligencia artificial Gemini fue objeto de más de 100.000 solicitudes de prueba por parte de actores que intentaban recrearlo. Estos ataques no fueron intrusiones tradicionales, sino un proceso de ingeniería inversa basado en la interacción constante con el sistema. El objetivo era recopilar una enorme cantidad de respuestas para entrenar un modelo similar sin necesidad de invertir los mismos recursos en investigación ni desarrollo.

Esta práctica, conocida como “destilación de conocimiento”, consiste en utilizar un modelo ya existente como guía para entrenar otro más pequeño o económico. En este caso, los atacantes buscaron replicar los patrones de respuesta y el estilo de razonamiento de Gemini, intentando crear una copia funcional que reprodujera su comportamiento.

La destilación: una técnica útil, pero con nuevas implicaciones éticas

La destilación no es un fenómeno nuevo en el ámbito de la inteligencia artificial. De hecho, se trata de una técnica legítima y ampliamente utilizada para optimizar modelos complejos, reduciendo su tamaño y consumo energético. Sin embargo, cuando se aplica sin consentimiento o con fines de apropiación, plantea cuestiones sobre la propiedad intelectual de los modelos y la protección de los datos que los sustentan.

El caso de Gemini pone sobre la mesa un debate cada vez más urgente: ¿cómo proteger la inversión en entrenamientos multimillonarios frente a intentos de copia mediante observación indirecta? Y, a la vez, ¿cómo mantener la apertura científica y la colaboración en un ecosistema de IA que se construye sobre el intercambio de ideas?

La respuesta de Google y el futuro de la seguridad en modelos generativos

Google ha señalado que está implementando medidas de monitorización y limitación de uso para detectar patrones de solicitud sospechosos. También explora la incorporación de mecanismos de seguridad embebidos en los modelos, capaces de identificar cuando sus respuestas están siendo explotadas para entrenar imitaciones. Estas estrategias buscan equilibrar la accesibilidad al modelo con la protección de su integridad y su valor comercial.

El caso de Gemini evidencia un nuevo frente en la seguridad de la IA: la defensa ante el robo de comportamiento y conocimiento. Más allá del código o los datos, el verdadero activo que debe protegerse es la inteligencia generada por el modelo mismo. En un momento en que los sistemas de IA son cada vez más potentes y accesibles, entender sus vulnerabilidades será clave para garantizar un desarrollo ético y sostenible.

La clonación de modelos mediante destilación plantea retos inéditos para la industria de la inteligencia artificial. Proteger el conocimiento sin frenar la innovación es el gran desafío que marcará la próxima etapa de esta tecnología. En Trixología seguiremos analizando estas tensiones, para entender cómo la IA puede avanzar sin perder su equilibrio esencial entre apertura y seguridad.