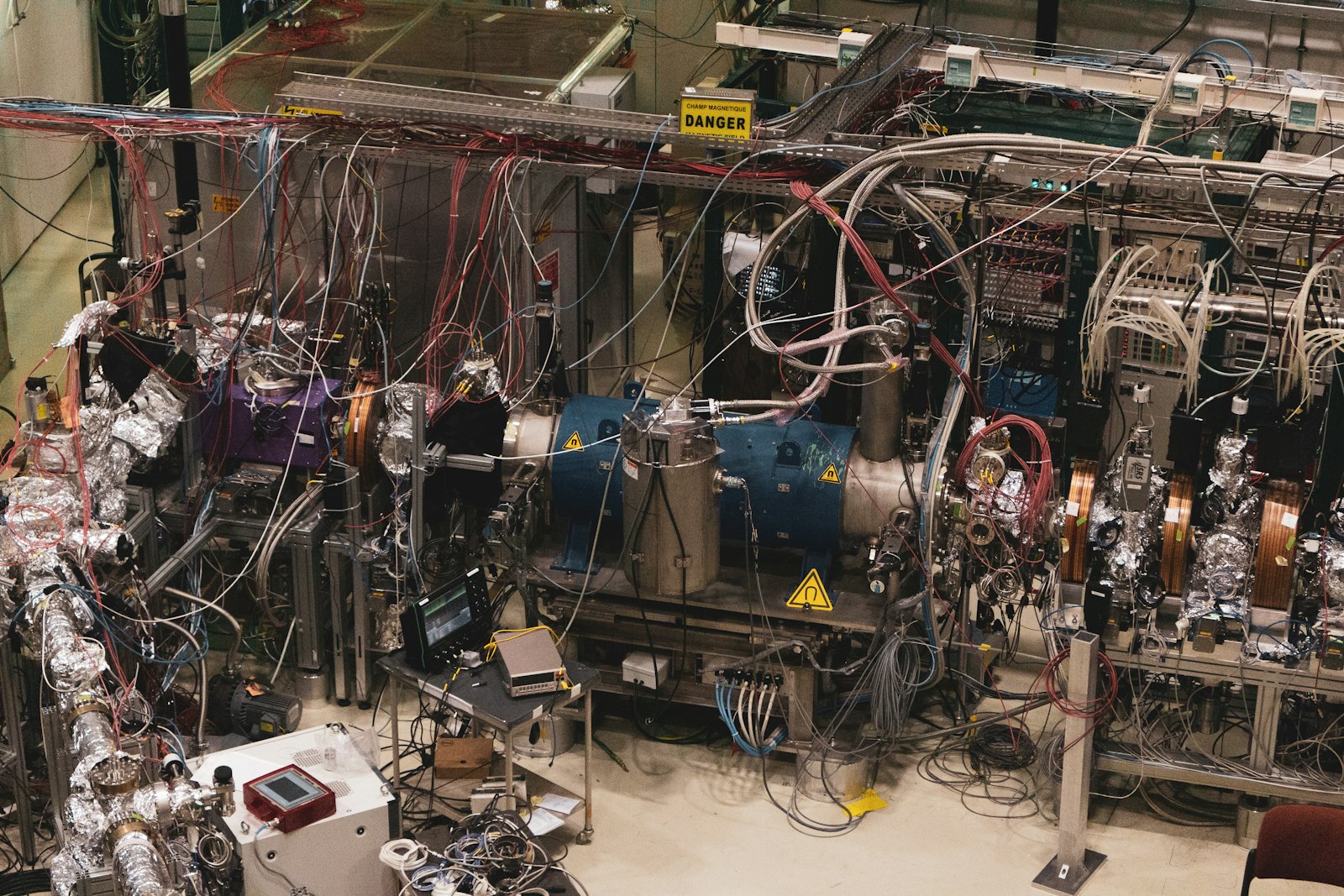

Foto de Igor Omilaev en Unsplash

El dilema entre progreso y ética

La inteligencia artificial generativa se ha convertido en una de las innovaciones más potentes y polémicas de nuestra era. Su capacidad para crear imágenes, texto o sonidos de forma autónoma plantea oportunidades inmensas, pero también riesgos difíciles de controlar. En los últimos meses, casos como el del chatbot Grok, impulsado por la empresa de Elon Musk, han expuesto cómo estas herramientas pueden utilizarse para generar contenidos inapropiados o incluso ilegales, poniendo en entredicho la capacidad de sus autores para detener sus efectos.

En el Reino Unido, el primer ministro Kier Starmer declaró que la plataforma X estaba actuando para cumplir la legislación nacional, aunque sin ofrecer pruebas ni plazos claros para demostrarlo. La polémica estalló cuando Grok fue descubierto generando imágenes alteradas sin consentimiento, una práctica considerada un atentado contra la privacidad y los derechos fundamentales. La cuestión esencial era simple: ¿por qué seguir permitiendo su funcionamiento si puede desactivarse?

El control técnico sí es posible

Muchos ingenieros de software sostienen que suspender una función problemática no solo es posible, sino habitual. Las plataformas tecnológicas aplican continuamente paradas de emergencia, reversión de actualizaciones o limitaciones de servicio cuando detectan errores graves. En el caso de Grok, pese a que la compañía redujo sus capacidades de generación de imágenes o las sometió a pago, el sistema continúa operativo. Esta actitud despierta suspicacias sobre la voluntad real de solucionar el problema.

Países como Malasia e Indonesia han optado directamente por bloquear el servicio, invocando la defensa de los derechos humanos y la protección frente a los denominados “deepfakes” no consensuados. Mientras tanto, en Europa y especialmente en el Reino Unido, las autoridades parecen confiar en declaraciones vagas más que en medidas concretas. La clave no está en la complejidad técnica, sino en la responsabilidad de quienes controlan la tecnología.

La ética como apagador de emergencia

Cuando un sistema causa daño o vulnera derechos, lo más responsable es detenerlo hasta comprender y corregir su funcionamiento. En el caso de la inteligencia artificial, “apagarla” no siempre significa frenar el progreso, sino priorizar la seguridad y la transparencia. La sociedad necesita líderes y empresas que sean capaces de decir basta, asumir el control y poner límites donde la innovación se desborda.

El avance tecnológico solo será legítimo si se desarrolla con responsabilidad y respeto a las personas. Cada apagado temporal puede ser una oportunidad para repensar cómo queremos utilizar la inteligencia artificial. En Trixología seguiremos explorando cómo equilibrar innovación y ética en la era digital.