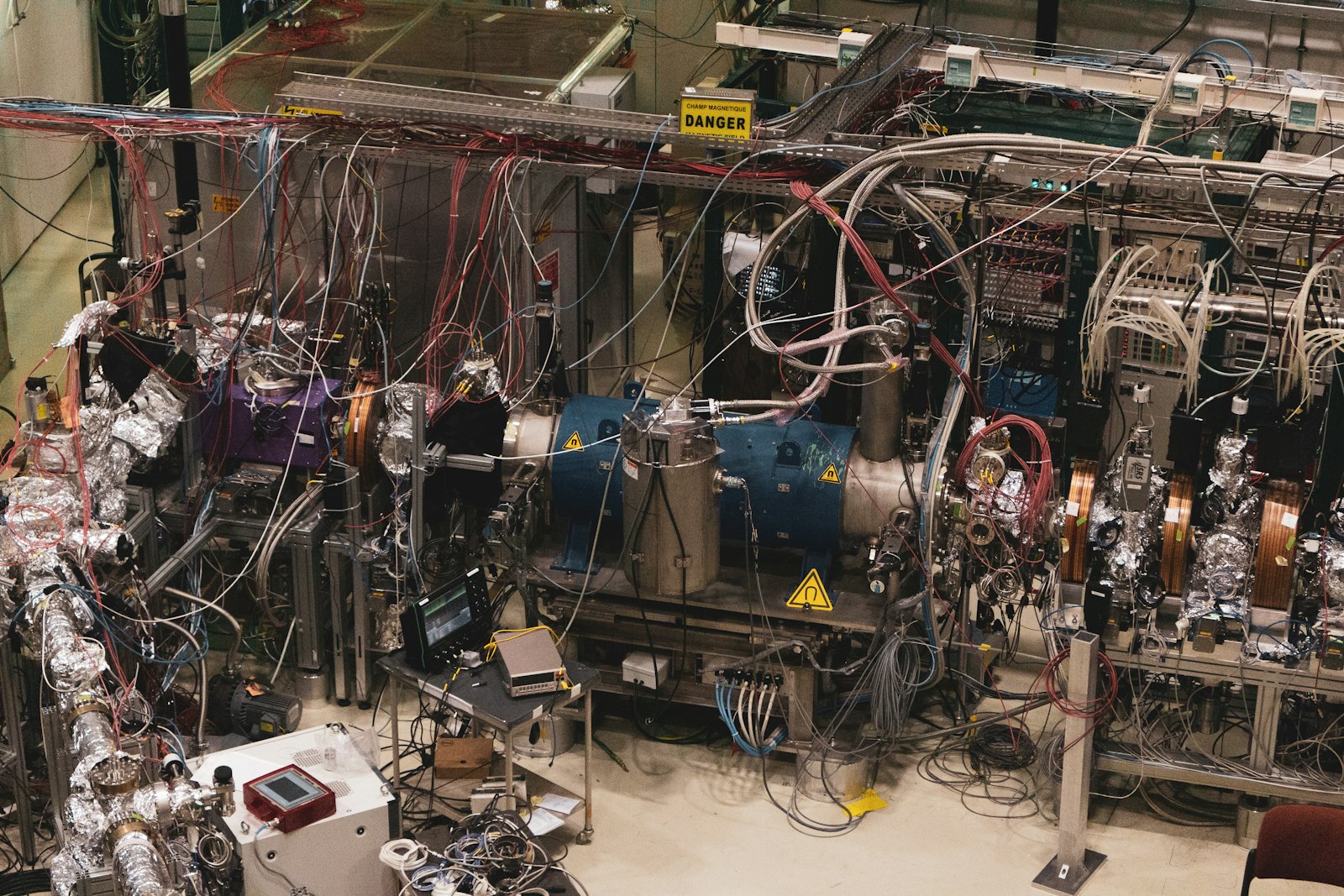

Foto de Wolfgang Hasselmann en Unsplash

Un aumento incontrolable de informes falsos

El equipo responsable de cURL, una de las herramientas de código abierto más utilizadas para transferencias de datos en la web, ha decidido suspender temporalmente su programa de recompensas por vulnerabilidades. Según su fundador y principal mantenedor, la causa principal es la avalancha de informes falsos generados por modelos de inteligencia artificial que, en lugar de ayudar, saturan los canales destinados a la seguridad del proyecto.

Durante los últimos meses, los mantenedores observaron un incremento drástico de reportes aparentemente bien redactados pero carentes de base técnica real. En muchos casos, el código proporcionado no compilaba o describía fallos inexistentes. Estos falsos positivos, impulsados por herramientas automáticas y usuarios inexpertos apoyados en modelos generativos, exigían analizar cientos de entradas innecesarias, dificultando la labor de detección de problemas auténticos.

La paradoja de la automatización: ayuda o ruido

La integración de sistemas basados en IA en tareas de revisión y auditoría de seguridad ha demostrado su valor en algunos contextos, pero también evidencia los límites del uso irresponsable de estas tecnologías. Generar informes automáticos sin verificación humana influye negativamente en proyectos de código abierto, donde el tiempo de los colaboradores es limitado y la precisión, crucial.

La situación de cURL no es un caso aislado. Otros proyectos de software libre han manifestado tener experiencias similares con aportaciones generadas por IA que no aportan valor real. La fatiga derivada de revisar contenido inútil repercute directamente en la moral de los desarrolladores, quienes expresan preocupación por su bienestar psicológico y la sostenibilidad de este modelo de colaboración.

Hacia un uso más responsable de la inteligencia artificial

La decisión de interrumpir las recompensas no pretende rechazar el papel de la IA en la seguridad informática, sino replantear su integración. El desafío actual consiste en equilibrar automatización y juicio humano, estableciendo filtros de calidad y sistemas que identifiquen cuándo un informe procede de un asistente generativo sin validación previa.

En un contexto donde las herramientas de IA proliferan con rapidez, la comunidad tecnológica se ve obligada a reflexionar sobre su verdadero impacto en los procesos colaborativos. La clave radica en fomentar su uso responsable y complementario, en lugar de sustituir la evaluación humana.

Este episodio deja una lección clara: incluso las tecnologías más avanzadas requieren criterio y control. En Trixología seguiremos explorando cómo equilibrar innovación y ética en la aplicación de la inteligencia artificial al desarrollo de software.